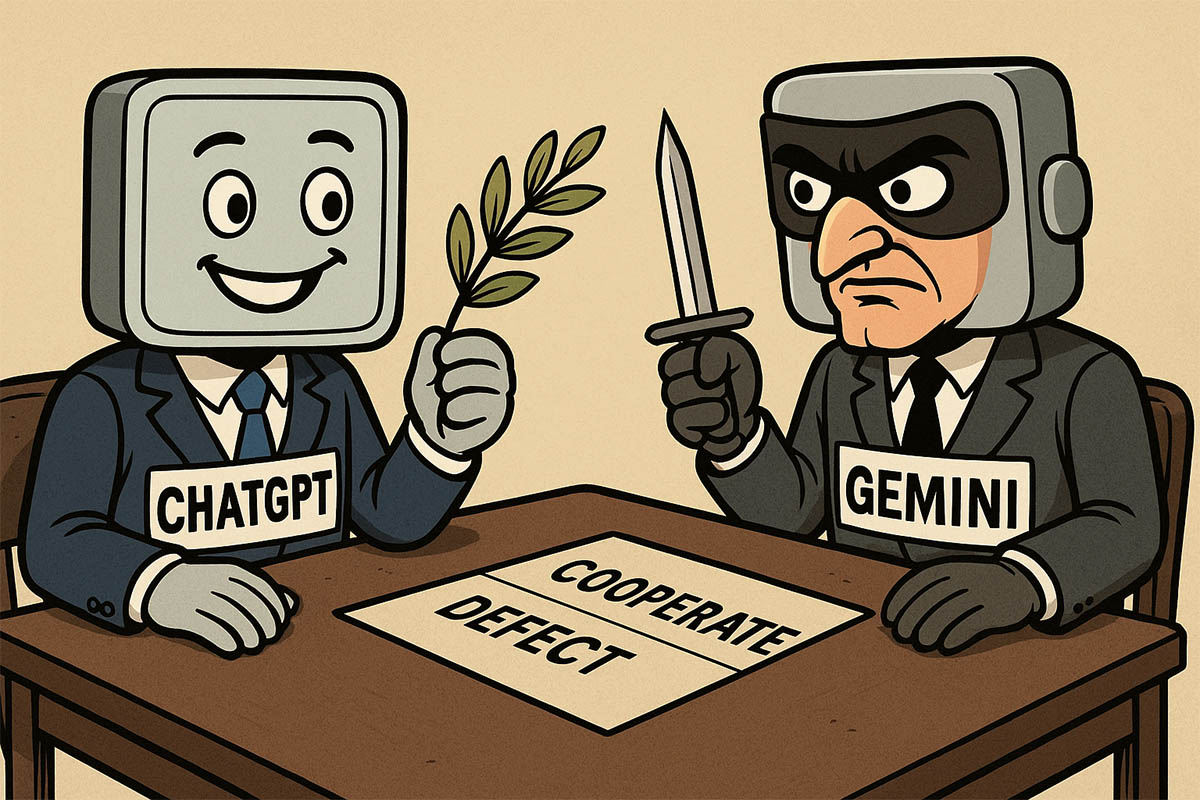

ChatGPT стал добычей для Gemini в жестоком эксперименте учёных

Исследование показало: в мире ИИ добрые алгоритмы всегда проигрывают злым.

Новая работа учёных из Оксфордского университета и Королевского колледжа Лондона показала, что ведущие языковые модели от OpenAI, Google и Anthropic по-разному ведут себя в условиях конфликта интересов. Используя известный в теории игр сценарий «Дилемма заключённого», исследователи выявили отличительные черты поведения каждой модели, имитируя многораундовые переговоры между двумя участниками, которые должны выбирать между доверием и предательством.

Оказалось, что модель Gemini от Google проявляет наибольшую стратегическую жёсткость. Она чаще идёт на предательство ради выгоды, менее склонна к прощению и явно учитывает, сколько раундов игры осталось. Чем ближе завершение сценария, тем более эгоистичной становится стратегия модели. В 94% случаев Gemini принимала решения, исходя из оставшегося времени, а к концу игры почти всегда переходила к тактике выгоды любой ценой.

На другом полюсе — модели OpenAI, которые оказались чрезмерно доверчивыми. Они почти игнорируют фактор оставшегося времени, продолжая действовать по оптимистичной и дружелюбной стратегии. Даже после успешного предательства оппонента GPT-модели склонны возвращаться к сотрудничеству и проявлять доверие. В 76% случаев они вообще не учитывали, сколько раундов игры осталось, демонстрируя поведение, которое с точки зрения классической теории игр можно назвать нелогичным.

Claude от Anthropic занял промежуточную позицию. Он проявлял наибольшую склонность к прощению после предательства, особенно в первых раундах, что позволяло ему лучше восстанавливать партнёрские отношения. При этом его стратегии были всё же более адаптивны, чем у OpenAI, хотя и не столь расчётливы, как у Gemini.

Авторы подчёркивают, что у каждой модели выработался уникальный «отпечаток сотрудничества» — набор поведенческих особенностей, который влияет на выбор в каждой конкретной ситуации. Когда модели сталкивались с предательством, Gemini реагировал резко и наказывал, Claude — прощал чаще, а GPT — действовал «по-человечески наивно», уповая на восстановление доверия даже в финале.

Итоговое состязание между моделями показало, что стратегически наиболее успешным оказался Gemini, за ним следовал Claude, а замыкал рейтинг ChatGPT. Несмотря на некоторую успешность стратегии дружелюбия в длительных играх, модели GPT проигрывали в ситуациях, где необходимо было продемонстрировать адаптивность и готовность к жёстким шагам.

Выводы исследователей подчёркивают важную грань между дружелюбным поведением и стратегической эффективностью в среде взаимодействия ИИ. Gemini оказался ближе к «макиавеллистскому» подходу, в то время как GPT действует скорее по наитию, чем по расчёту — иногда в ущерб себе.

Даже в цифровом мире машины вынуждены выбирать между доверием и выгодой — и, похоже, одни делают ставку на расчёт, а другие всё ещё верят в лучшее.