GitHub повысит производительность и безопасность инструмента Copilot в ближайшем обновлении

ИИ будет быстрее давать рекомендации, а также блокировать любые конфиденциальные данные.

GitHub Copilot был выпущен в июне 2022 года. Он представляет собой программное обеспечение на основе искусственного интеллекта, которое использует OpenAI Codex для генерации исходного кода и рекомендаций по функциям Visual Studio в режиме реального времени. Компания утверждает, что скоро Copilot станет ещё мощнее и безопаснее.

По словам представителей GitHub, новая модель искусственного интеллекта, которая будет представлена пользователям уже на этой неделе, предлагает более качественные рекомендации за более короткое время, что ещё больше повышает эффективность разработчиков программного обеспечения, использующих эту модель.

Copilot представит новую функцию под названием «Заполнение посередине» («Fill-In-the-Middle»), которая использует библиотеку известных суффиксов кода и оставляет пробел для заполнения ИИ-инструментом, обеспечивая большую актуальность и согласованность с остальной частью кода проекта. Кроме того, GitHub обновил клиент Copilot, уменьшив количество нежелательных рекомендаций на 4,5%, что повысило общий уровень приемлемости кода.

«Когда мы впервые запустили GitHub Copilot для частных лиц в июне 2022 года, в среднем более 27% файлов кода разработчиков были сгенерированы им. Однако сегодня на GitHub Copilot приходится в среднем уже 46% кода разработчиков на всех языках программирования, а для Java эта цифра достигает 61%», — сказал Шуин Чжао, старший директор по управлению продуктами GitHub.

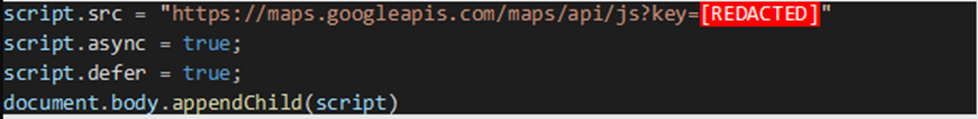

Одним из основных улучшений в этом обновлении Copilot является введение новой системы фильтрации уязвимостей безопасности, которая поможет выявлять и блокировать небезопасные рекомендации, такие как жестко запрограммированные учетные данные, внедрение пути и внедрение SQL.

«Новая система использует LLM (большие языковые модели) для аппроксимации поведения инструментов статического анализа. А поскольку GitHub Copilot запускает расширенные ИИ-модели на мощных вычислительных ресурсах, она невероятно быстра и может даже обнаруживать уязвимые шаблоны в незавершенных фрагментах кода. Это означает, что небезопасные шаблоны быстро блокируются и заменяются альтернативными безопасными», — сказал Чжао.

В GitHub заявляют, что Copilot может генерировать так называемые «секреты»: ключи, учётные данные и пароли. Однако их нельзя будет использовать в реальных проектах, поскольку они полностью вымышлены и будут блокироваться новой системой фильтрации.

Пример блокировки ключа в реальном времени

Появление «секретов» вызвало резкую критику со стороны сообщества разработчиков программного обеспечения. Многие обвиняли Microsoft в использовании больших наборов общедоступных данных для обучения своих ИИ-моделей без особого внимания к безопасности и вопросам авторского права. Включая наборы, которые ошибочно содержат «секреты».

Тем не менее, блокируя небезопасные рекомендации в режиме реального времени, GitHub может обеспечить некоторую защиту от атак с отравленными наборами данных, направленных на скрытое обучение ИИ-помощников делать рекомендации, содержащие вредоносную полезную нагрузку.

В настоящее время LLM Copilot всё ещё обучается различать уязвимые шаблоны кода, поэтому ожидается, что производительность ИИ-модели в этом направлении будет постепенно улучшаться в ближайшем будущем.