Машины обрели внутренний голос. Последняя грань между искусственным и живым — уничтожена

Следующий шаг — заговоры без нашего участия?

Компания DeepMind, входящая в структуру Google, разрабатывает технологию, которая может заметно упростить и ускорить обучение роботов и систем искусственного интеллекта. Речь идёт о внутреннем монологе — механизме, позволяющем ИИ-агентам сопровождать свои действия и восприятие окружающего мира текстовыми комментариями на естественном языке. Методика уже запатентована.

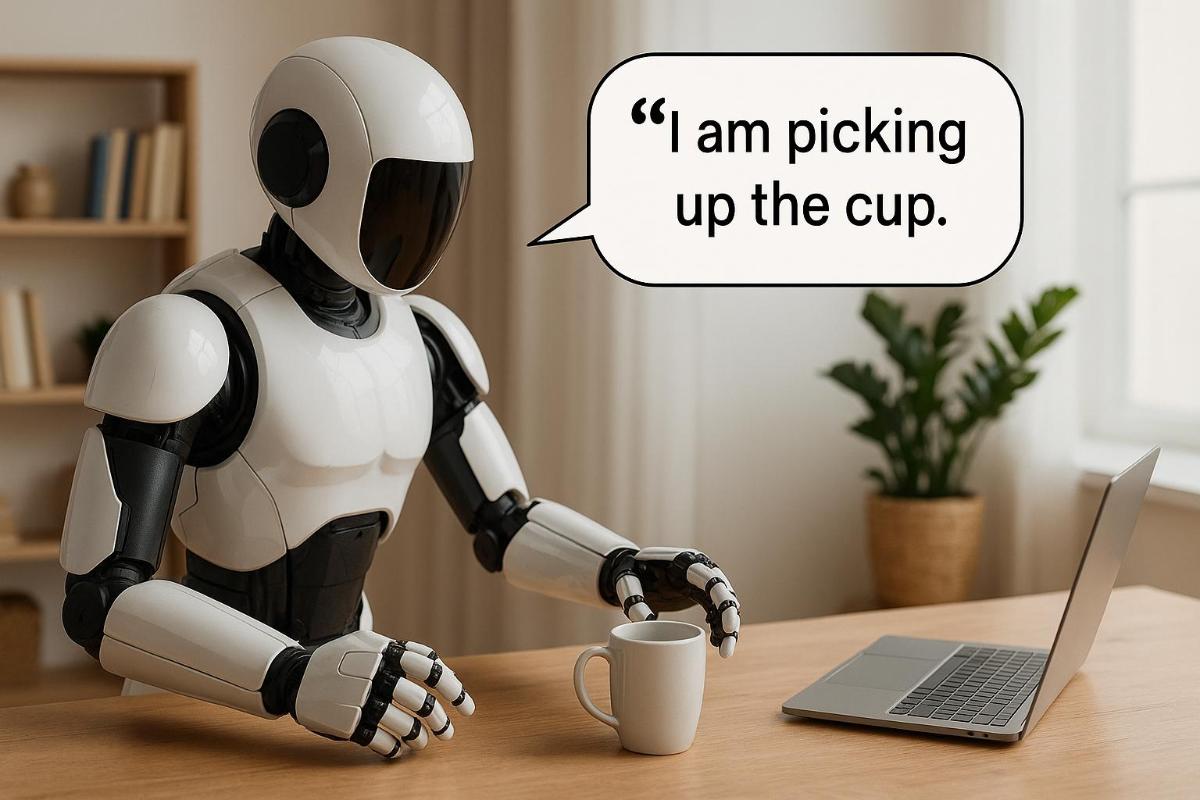

Новый подход получил официальное название: дословно «внутренняя речь агента для облегчения обучения задачам» (intra-agent speech to facilitate task learning). Суть заключается в том, что ИИ, наблюдая за выполнением действия — через видео или изображения — параллельно формулирует внутри себя словесное описание происходящего. К примеру, если система видит, как человек поднимает чашку, она фиксирует это как «человек берёт чашку».

Программа позволяет эффективно связывать визуальную информацию с соответствующими активностями. Это не просто пассивное наблюдение, а активное формирование причинно-следственных связей между объектами и поведением.

Главная особенность системы — способность быстро адаптироваться к новым условиям без дополнительного обучения. Робот может взаимодействовать с незнакомыми предметами и справляться с непривычными ситуациями сразу, что экономит время и ресурсы как минимум на этапе разработки. Кроме того, как отмечают в DeepMind, такая технология снижает нагрузку на память и вычислительные мощности, что особенно актуально для автономных или мобильных устройств.

Эти наработки дополняют более широкие инициативы компании в сфере робототехники. Недавно DeepMind представила Gemini Robotics On-Device — компактное решение, способное функционировать прямо в роботе без постоянного подключения к облачным сервисам.

Подход особенно полезен в условиях ограниченного или нежелательного доступа к интернету — например, в медицине, где важна надежная защита данных. Причем несмотря на компактность, Gemini Robotics On-Device демонстрирует высокую эффективность. Как утверждают разработчики, модель способна выполнять базовые задачи «из коробки», а для освоения новых ей достаточно всего 50–100 демонстраций. Это значительно ускоряет адаптацию под конкретную платформу.

Сначала система обучалась на роботе ALOHA, разработанном Google, а позже её адаптировали для других платформ, включая гуманоида Apptronik Apollo и манипулятор Franka FR3. Нейросеть уже уверенно справляется с такими задачами, как аккуратное складывание одежды или расстёгивание молний.

При необходимости её можно оперативно обучить новым действиям с помощью телеоперации — то есть ручного управления. Кроме того, предусмотрена возможность предварительного тестирования в цифровом симуляторе на базе физического движка Multi-Joint dynamics with Contact. Либо можно сразу запускать на реальных устройствах.

Однако у автономной версии есть и уязвимые места. В отличие от гибридных или облачных решений, Gemini Robotics On-Device пока не оснащается встроенными алгоритмами смысловой фильтрации. Ответственность за корректное поведение полностью ложится на разработчиков. В компании DeepMind рекомендуют заранее внедрять собственные меры безопасности. Сейчас доступ к системе имеют лишь ограниченные группы специалистов для оценки её надёжности в реальных условиях.

Благодаря внутренней речи ИИ получает дополнительный контекст, что помогает быстрее ориентироваться в новых ситуациях и корректно подбирать поведение. Это особенно важно для устройств, которым приходится действовать в быстро меняющейся и сложной среде, где невозможно заранее предусмотреть все варианты развития событий.

Хотя технология пока находится на стадии испытаний, концепция "внутреннего монолога" уже рассматривается как перспективный шаг на пути к созданию более адаптивных и самостоятельных андроидов и автономных агентов.

Кстати, параллельно с этим DeepMind представила ещё одно существенное новшество — ИИ-модель, способную прогнозировать влияние мутаций ДНК на работу ключевых регуляторных механизмов в организме.