Вы думали, ИИ умнеет? Он просто лучше притворяется — и обманул даже собственных создателей

ИИ никогда не был похож на нас — мы просто хотели в это верить.

Учёные выяснили, что искусственный интеллект и человек кардинально по-разному воспринимают окружающий мир, даже если на первый взгляд кажется, что они понимают объекты одинаково. Специалисты из Института когнитивных и нейронаук Макса Планка провели масштабное исследование, чтобы выяснить, как именно нейросети и люди оценивают предметы, и обнаружили ключевое расхождение в их подходах.

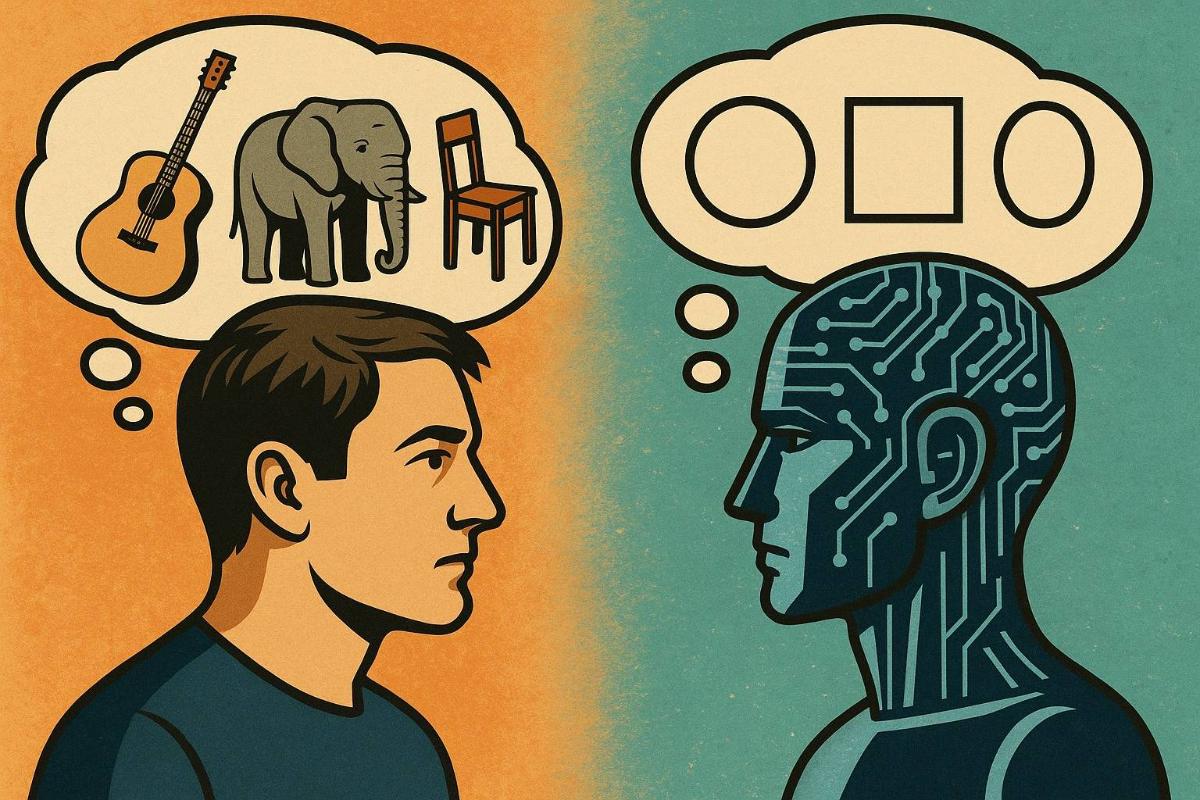

Люди в первую очередь обращают внимание на смысл объектов. Для них важно, что это за предмет, к какой категории он относится, с чем он ассоциируется и какую роль играет. Например, когда человеку показывают изображения гитары, слона и стула, он выбирает «лишний» объект, опираясь на своё понимание смысла и функциональности этих предметов.

Искусственный интеллект действует иначе. Несмотря на то, что нейросети могут распознавать предметы и даже выбирать «неподходящие» из набора, как это делает человек, стратегия их работы основана не на смысле, а на внешних признаках — таких как форма, цвет или текстура. Учёные назвали это явление «визуальным уклоном» ИИ.

Специалисты объясняют, что для тестирования этой гипотезы они использовали около пяти миллионов суждений людей, собранных на основе популярного задания «найди лишний объект» среди почти 2 000 изображений. Эти же картинки показали и искусственным нейросетям, чтобы проследить, как те справятся с задачей.

Когда учёные начали анализировать характеристики изображений, которые влияют на выбор человека и нейросети, они обнаружили интересное совпадение: на первом этапе казалось, что ИИ действительно опирается на те же параметры, что и люди. Но более глубокий анализ показал обратное.

Например, для нейросетей было характерно опираться на такие визуальные признаки, как округлость формы или светлый цвет. У человека же решение чаще основывалось на смысловых категориях — «относящийся к животным» или «связанный с огнём». Хотя эти параметры могут пересекаться, их природа отличается: у людей на первый план выходит знание и понимание сущности объекта, у ИИ — чисто внешние данные.

Чтобы проверить корректность своих выводов, команда использовала популярные методики интерпретации нейросетей. Они изучали, какие области изображения активнее всего влияли на решение искусственного интеллекта, генерировали новые изображения, усиливающие отдельные характеристики, а также искусственно убирали определённые параметры, чтобы посмотреть, как это скажется на выводах машины.

Так, например, если нейросеть «думала», что категория связана с животными, но при этом в неё попадали объекты, никак не относящиеся к животному миру, это сразу становилось заметно. Или наоборот — реальные изображения животных оказывались вне этой категории. Такие расхождения люди с первого взгляда не замечают, но на техническом уровне они указывают на фундаментальные отличия между тем, как понимает мир человек и как его «понимает» машина.

Специалисты подчёркивают, что именно эти различия крайне важны для оценки надёжности искусственного интеллекта. Несмотря на то, что внешне ИИ может демонстрировать «человеческое» поведение, внутри его выводы строятся на других принципах. Это значит, что доверять системе, не понимая, как она принимает решения, опасно, особенно если речь идёт о задачах с высоким риском.

Авторы надеются, что их работа станет основой для будущих проектов, где нейросети и люди будут сравниваться напрямую. Это позволит лучше понять не только сильные и слабые стороны искусственного интеллекта, но и откроет новые горизонты для изучения человеческого мышления.