Философы впервые в истории пришли к единому мнению — и это случилось из-за машин

Машины учатся выбирать между злом и меньшим злом.

Когда автономные автомобили станут полноправными участниками дорожного движения, они неизбежно столкнутся с моральными дилеммами. Как поступить, если все варианты плохи? Кого «спасти», если избежать столкновения невозможно? Чтобы научить машины принимать такие решения, исследователи из Университета штата Северная Каролина разработали и впервые проверили на практике методику, способную объективно зафиксировать моральные установки человека в повседневных ситуациях на дороге.

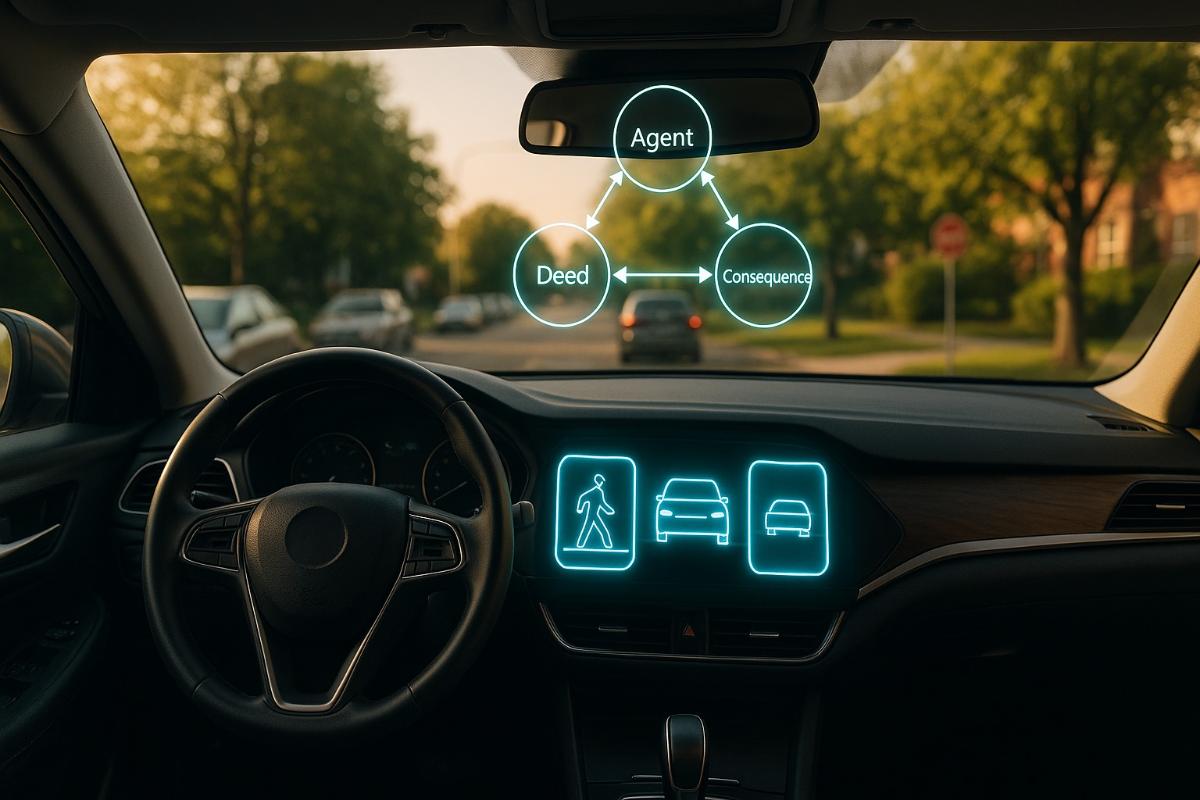

Работа опубликована в журнале Frontiers in Psychology. В ней команда использует модель ADC (Agent-Deed-Consequence — агент, поступок, последствие), которая анализирует моральное поведение через три ключевых аспекта: кто принимает решение, какое именно действие совершает и к каким результатам оно приводит. Методика была протестирована в специально разработанных «низкоставочных» дорожных сценариях, где отсутствует прямая угроза жизни, но присутствует моральный выбор: проехать на пару миль быстрее допустимого, не остановиться полностью на стоп-линии, проигнорировать пешехода в нерешительной позе.

Для проверки точности метода был выбран «самый критичный круг респондентов» — философы. В исследовании приняли участие 274 человека с учёными степенями по философии, представляющие различные школы моральной мысли — от утилитаристов до деонтологов и приверженцев этики добродетели. Им предлагались ситуационные описания дорожных эпизодов, после чего участники отвечали на серию вопросов о моральной приемлемости поведения водителя, о намерениях, поступках и последствиях.

Авторы также применили уже зарекомендовавшие себя шкалы для диагностики моральных ориентиров респондентов. Смыслом эксперимента было выяснить, насколько различия в философских подходах повлияют на интерпретацию одних и тех же сценариев. И вот здесь возник неожиданный результат: вне зависимости от философской школы, все участники сходились в суждениях о том, какие действия являются морально приемлемыми, а какие — нет.

По мнению специалистов, это означает, что предложенная методика позволяет зафиксировать универсальные суждения о морали в дорожных ситуациях и может быть применена для обучения искусственного интеллекта. Ведь если даже философы, традиционно склонные к спорам, приходят к единым выводам, значит, заложенные в модель параметры действительно отражают общественное восприятие «правильного» и «неправильного» поведения за рулём.

Следующий этап — расширение выборки за пределами академической среды. Учёные планируют провести массовое тестирование с участием представителей разных возрастов, культур и языков. Цель — выяснить, насколько универсален выявленный моральный консенсус и можно ли на его основе построить этически ориентированную систему для принятия решений в беспилотных транспортных средствах.