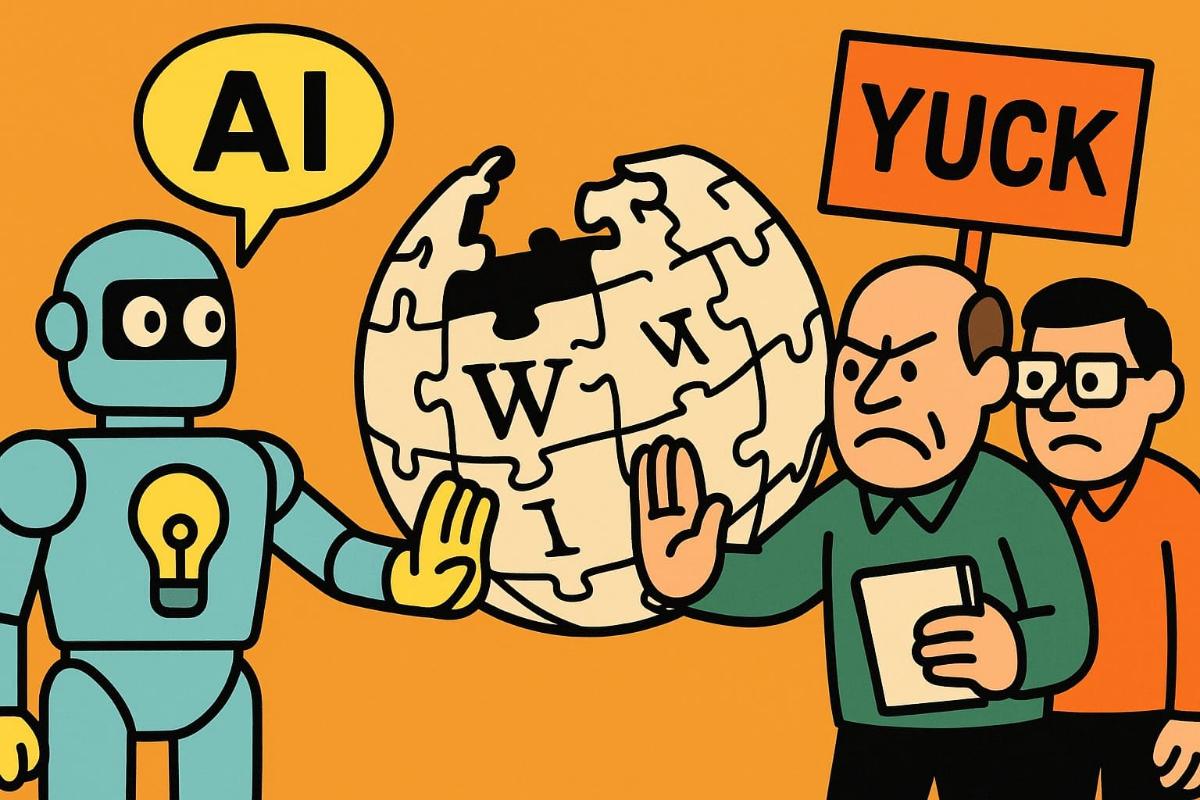

ИИ решил упростить Wikipedia — и едва не сломал её дух

Что-то пошло не так с ИИ — и это почувствовали все, кто верит в ручной труд.

The Wikimedia Foundation временно остановил эксперимент с автоматической генерацией кратких резюме статей, которые показывались пользователям Wikipedia в начале страницы. Причиной стало резкое и почти единогласное недовольство сообщества редакторов, которые сочли такую инициативу вредной для репутации и принципов проекта.

Сами резюме создавались с помощью модели Aya от компании Cohere и отображались в браузерном расширении Wikipedia. Они появлялись в верхней части статьи с жёлтой отметкой «Unverified» и разворачивались по нажатию. Официально эксперимент начался 2 июня и изначально должен был продлиться две недели, быть добровольным и касаться мобильной версии сайта. Однако после шквала негативных комментариев его быстро свернули.

Краткая ИИ-сводка статьи (404 Media)

Многие участники сообщества резко отреагировали на внедрение генеративного ИИ. Один из редакторов назвал эксперимент прямым оскорблением читательского интеллекта, подчеркнув, что Wikipedia стала символом надёжности и сдержанности именно благодаря ручному подходу и исключению «пестроты» и алгоритмической подачи информации. Он отметил, что проект рискует потерять доверие и «осквернить десятилетия работы над политикой достоверности».

Редакторы массово оставляли односложные и жёсткие отзывы — от «абсолютно нет» до «самая плохая идея». Ключевая претензия заключалась в том, что один автоматически сгенерированный текст, вынесенный наверх страницы, разрушает коллективную модель редактирования и не оставляет пространства для альтернативных мнений, тем самым нарушая принцип нейтральной точки зрения. По мнению участников обсуждения, это противоположно идее вики-платформы как живой и совместной энциклопедии.

Эксперимент под названием «Simple Article Summaries» был предложен после обсуждений на конференции Wikimania в 2024 году, где звучали идеи об использовании машинного перефразирования для упрощения сложных текстов. Однако даже сторонники идеи отмечали необходимость прозрачной маркировки ИИ-контента и системы модерации, позволяющей легко отмечать ошибки или неточности.

Представитель Фонда заявил, что целью было сделать сложные статьи более доступными для читателей с разным уровнем подготовки. При этом подчёркивается, что внедрение ИИ в работу Wikipedia будет возможно только при условии активного участия редакторов и наличия инструментов контроля.

Позже представитель проекта признал, что диалог с сообществом был выстроен недостаточно чётко и прозрачно. По его словам, обсуждение следовало начать заранее на технической площадке VPT еще в марте, чтобы подготовить редакторов и открыть полноценную дискуссию.

Хотя эксперимент и приостановлен, в Фонде подчёркивают, что интерес к возможностям генеративного ИИ сохраняется. Однако любые будущие проекты будут реализовываться только при участии сообщества и с учётом опыта текущей ситуации. Окончательное решение о развитии таких функций будет приниматься совместно с редакторами, а не в одностороннем порядке.

Семантическая ценность Википедии во времена массового засорения интернета ИИ-контентом стала особенно значимой. Пока крупные платформы, такие как Google, стремятся внедрить автоматические краткие сводки, Википедия остаётся островком ручного труда и проверенной информации. И, судя по реакции сообщества, её участники готовы сражаться за сохранение этих принципов.

В октябре 2024 года группа энтузиастов-редакторов Wikipedia запустила новый проект под названием WikiProject AI Cleanup. Их цель - противостоять наплыву некачественного контента, созданного искусственным интеллектом. Инициатива нацелена на выявление и устранение плохо написанных или недостоверных текстов, которые могут ухудшить общее качество информации на платформе.