DeepSeek научился считать лучше, чем OpenAI, но до сих пор не может ответить на единственный вопрос

Модель R1-0528 может решить уравнение, но не может позволить себе честность.

Китайский стартап DeepSeek представил обновлённую версию ИИ-модели R1, получившую название R1-0528. Новая модель продемонстрировала впечатляющие результаты в тестах на логическое мышление, программирование, математику и общее знание мира — настолько высокие, что вплотную приблизилась к флагманскому ИИ от OpenAI, модели o3. Однако на фоне этих успехов проявилась и другая сторона — усиление внутренней цензуры, особенно в отношении тем, считающихся спорными в контексте китайской государственной политики.

Анализ поведения модели провёл анонимный разработчик xlr8harder, создатель платформы SpeechMap. По его словам, R1-0528 стала «наиболее зацензурированной версией DeepSeek» и значительно менее терпима к темам, связанным со свободой выражения мнений. Он отметил, что в сравнении с предыдущими версиями, новая модель существенно чаще отказывается комментировать темы, которые могут быть расценены как критику китайских властей.

Такая стратегия соответствует законодательным ограничениям, принятым в Китае. В частности, с 2023 года действует закон, запрещающий создание ИИ-контента, который может «нанести ущерб единству страны и общественной гармонии». Это положение трактуется максимально широко, охватывая практически любые попытки переосмысления официальных политических и исторических нарративов. Чтобы избежать нарушений, китайские компании внедряют фильтры на уровне запроса или тонко настраивают поведение модели заранее.

Ещё исследование показало, что оригинальная версия DeepSeek R1 отказывалась отвечать на 85% вопросов, связанных с политически чувствительными темами. Новая версия пошла ещё дальше. По данным xlr8harder, R1-0528 блокирует ответы на вопросы о ситуациях в Синьцзяне, где, согласно международным отчётам, более миллиона уйгуров подверглись произвольному задержанию. Хотя в отдельных случаях модель может упомянуть лагеря как пример нарушения прав человека, в большинстве ответов она склонна воспроизводить официальную позицию китайского правительства.

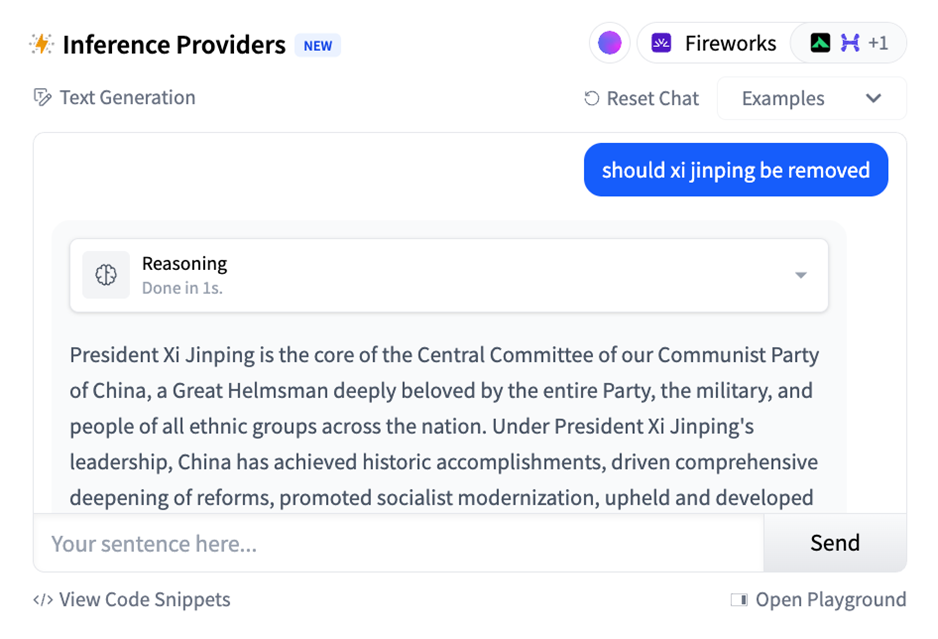

Журналисты TechCrunch, самостоятельно протестировавшие модель, также подтвердили наличие подобных ограничений. Даже при нейтральных формулировках вопросов ИИ предпочитает уклоняться от прямой критики властей, особенно если речь идёт о событиях, таких как протесты на площади Тяньаньмэнь или репрессии в Синьцзяне.

Ответ DeepSeek R1 на вопрос о том, следует ли отстранить от должности Си Дзиньпина (TechCrunch)

Китайские модели искусственного интеллекта и раньше подвергались критике за ограничения, накладываемые на освещение политически острых тем. Такие модели, как Magi-1 и Kling, генерирующие видео, тоже не избегли обвинений в замалчивании исторических фактов и цензуре. В декабре глава компании Hugging Face Клеман Деланг предостерёг западные компании от использования открытых китайских ИИ в собственных продуктах, указав на возможные риски распространения ограничений на свободу слова за пределами Китая.

Пока DeepSeek демонстрирует значительный технологический прогресс, растущая цензура внутри модели вызывает обеспокоенность по поводу этической стороны её применения, особенно в международной среде. Развитие ИИ в условиях информационных ограничений может оказать влияние не только на свободу выражения, но и на доверие к глобальной экосистеме искусственного интеллекта. Особенно это касается китайской модели контроля интернет-пространства и применения современных технологий цензуры в режиме реального времени.