Новая эра осязания: когда роботы 'ощущают' лучше людей

Исследователи создают сенсор, превосходящий человеческое восприятие.

Ученые разработали роботизированную сенсорную систему, способную различать различные типы тканей, включая вельвет. Это открытие может значительно улучшить виртуальную реальность, обеспечив более детальное восприятие ощущений.

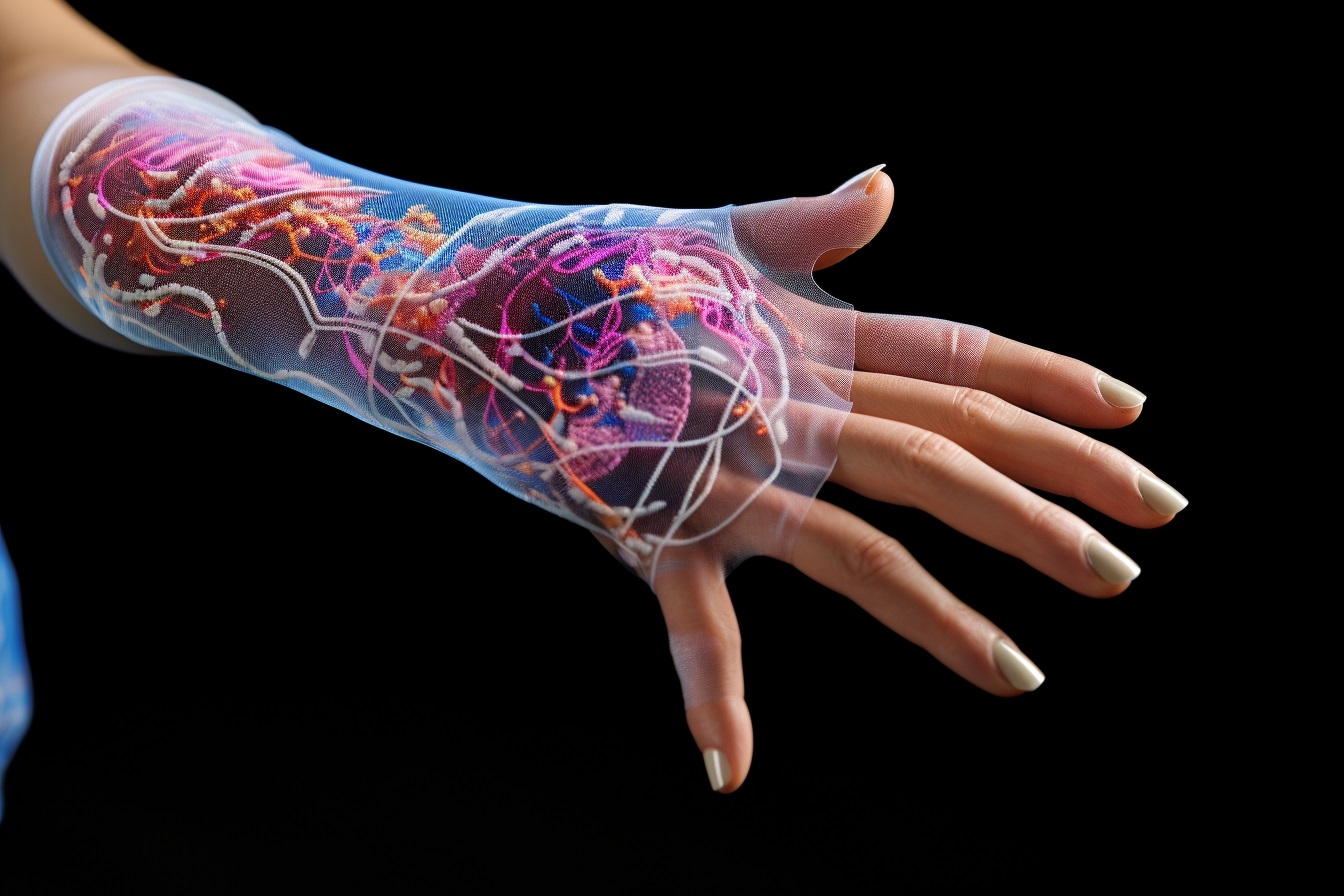

Система основана на использовании гибкого сенсора скольжения, имитирующего человеческий отпечаток пальца. Это позволяет устройству распознавать мелкие детали на поверхности ткани при касании или скольжении. Такой подход находит применение в робототехнике и протезировании человеческих конечностей.

Исследование, проведенное командой Чуань Фэй Го из Южного университета науки и технологий в Шэньчжэне, Китай, выявило, что предыдущие попытки создать сенсоры на уровне человеческого осязания были неэффективны из-за ограничения на физические стимулы, такие как давление, не учитывая движение по поверхности.

Разработанный сенсор способен собирать данные, скользя по поверхности материала. Он успешно распознал 20 видов тканей, включая ткань тренчкота и вельвет, с точностью 100% при постоянной скорости и 98,9% при случайных скоростях скольжения.

Сенсор, сделанный из настраиваемых электрических двойных слоев с наноэлектрическим зарядом, обладает чувствительностью до 51 900 Паскалей и пространственным разрешением до 15 микрометров в ширину и 6 микрометров в высоту.

Ученые утверждают, что система улучшит технологии осязания в робототехнике и протезировании, а также будет полезна для восстановления чувствительности у пациентов с искусственными протезами, в виртуальной реальности и потребительской электронике.

Система обрабатывает сигналы с пространственно-временной информацией, используя машинное обучение, и выводит результаты в визуальный интерфейс пользователя.

Исследователи заявляют, что такая система не только полезна в робототехнике, но и может найти применение в здравоохранении и потребительской электронике, помогая людям достигнуть улучшенных тактильных функций и предлагая новые технологии для метавселенной.