Google представила крупнейшую нейросеть PaLM-E для автономного управления роботами

Мультимодальная визуальная языковая модель с 562 млрд. параметров может генерировать последовательность действий без участия человека.

6 марта группа исследователей искусственного интеллекта из Google и Берлинского технического университета представила PaLM-E, мультимодальную визуальную языковую модель (VLM) с 562 млрд. параметров, которая объединяет компьютерное зрение и язык для управления роботами.

Учёные утверждают, что это самая большая VLM-модель из когда-либо созданных и что она может выполнять множество задач без необходимости переобучения.

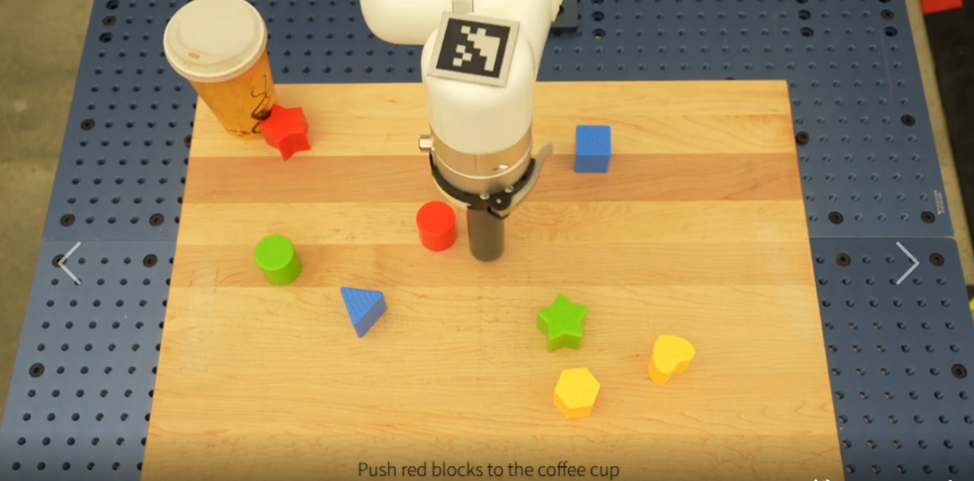

При получении сложной команды, состоящей из нескольких объектов (например, «принеси мне чипсы из ящика»), PaLM-E генерирует план действий для мобильной роботизированной платформы с рукой (разработанной Google Robotics) и выполняет действия самостоятельно.

PaLM-E работает, анализируя данные с камеры робота, не требуя предварительно обработанного представления сцены. Это устраняет необходимость в аннотировании данных человеком и обеспечивает автономное управление роботом. Стоит отметить, что, если PaLM-E интегрирована в контур управления, она становится устойчивым к прерываниям, которые могут возникнуть во время выполнения задачи

В исследовательской работе Google объясняется, как PaLM-E превращает инструкции в действия. Исследователи следуют установке в Ahn et al (2022), где роботу необходимо планировать последовательность навигационных и манипулятивных действий на основе инструкций человека.

Например, учитывая инструкцию «Я пролил свой напиток, принеси мне что-нибудь, чтобы убрать здесь», робот должен спланировать последовательность действий:

- Найти губку;

- Поднять губку;

- Принести губку пользователю;

- Положить губку.

Эксперты разрабатывают 3 варианта использования для проверки способностей PaLM-E к рассуждению: прогноз доступности, обнаружение сбоев и долгосрочное планирование. Политики низкого уровня взяты из RT-1 (Brohan et al., 2022), модели преобразователя, которая использует RGB-изображение и инструкции на естественном языке.

Модель PaLM-E основана на существующей большой языковой модели (LLM) Google под названием «PaLM» (похожа на технологию, лежащую в основе ChatGPT), только в неё добавлена сенсорная информация и роботизированное управление.

PaLM-E также опирается на модель распознавания образов Google ViT-22B, которая может классифицировать изображения, обнаруживать объекты, проводить семантическую сегментацию и создавать подписи к изображениям. Более того, PaLM-E может передавать полученные знания и навыки, что значительно увеличивает производительность по сравнению с однозадачными моделями.

Исследователи утверждают, что PaLM-E демонстрирует совершенно новые возможности, такие как:

- мультимодальная логическая цепочка рассуждений (модель анализирует последовательность входных данных, включающих как языковую, так и визуальную информацию);

- мультиобразный вывод (использование нескольких изображений в качестве входных данных, чтобы сделать вывод или прогноз).

Специалисты Google планируют использовать возможности PaLM-E для реальных сценариев в автоматизации дома или промышленной робототехнике.