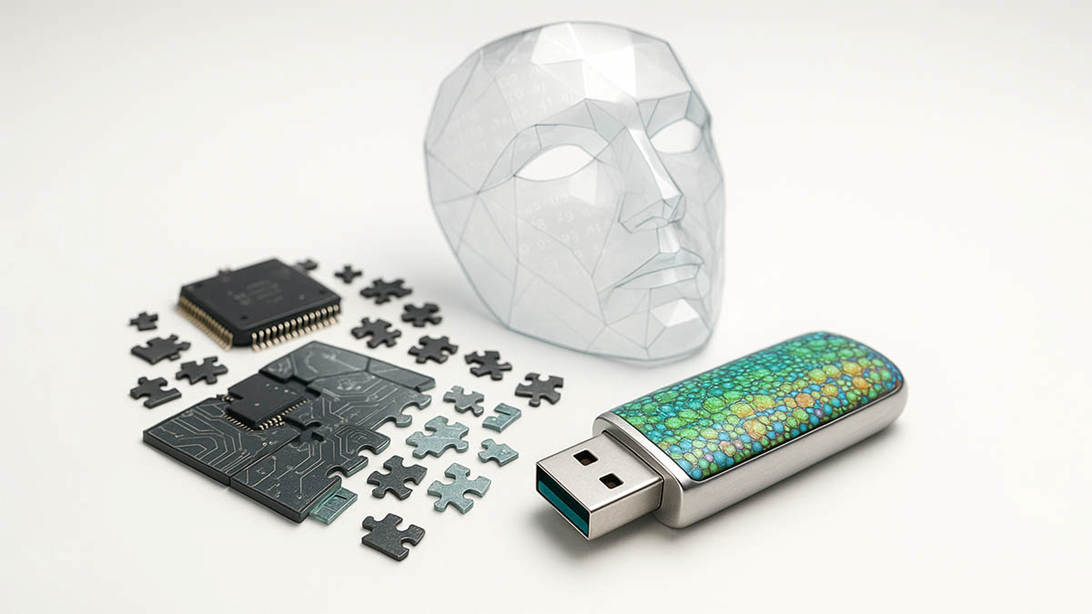

В индустрии кибербезопасности словом «морфер» называют класс инструментов и компонентов, которые системно меняют внешний облик вредоносных программ, не трогая их поведение. Иными словами, полезная нагрузка делает одно и то же, но каждый новый экземпляр выглядит уникально на уровне байт, строк, импортов, структуры секций, управляющих переходов и даже временных меток.

Производители антивирусов десятилетиями полагались на сигнатуры и статические признаки, а морферы аккуратно ломают такие ожидания, создавая почти бесконечные вариации упаковок и программных «масок». В экосистеме преступных сервисов это автономные утилиты, встроенные движки в загрузчиках, облачные генераторы «чистых» билдов, а иногда — небольшие серверные модули, которые на лету модифицируют бинарники перед отправкой жертве.

Понять морфер полезно всем, кто строит защиту: специалистам по реагированию, инженерам по безопасной разработке, аналитикам угроз, экспертам по реверсу и даже администраторам, которые фильтруют вложения на шлюзах. Ниже — связное описание того, как устроены такие механизмы, какие приёмы используются, как выглядит цепочка создания изменяемых экземпляров и на каких уровнях становятся эффективными методы обнаружения.

Терминология и базовые модели маскировки

Устойчивых определений множество, однако в практическом смысле морфер — это компонент, отвечающий за вариативность представления программы. На одном краю — полиморфизм: код шифруется, оболочка при каждом выпуске меняет ключ и дешифратор, но тело после восстановления совпадает. На другом краю — метаморфизм: генератор перестраивает машинные инструкции так, что после распаковки получается функционально эквивалентный, но синтаксически новый вариант. Между ними располагаются классические упаковщики, шифраторы, «криптеры» и виртуализирующие обфускаторы, где полезная логика исполняется в абстрактной машине и скрывается за псевдоинструкциями.

Важно отличать морфер от банального компрессора: последний уменьшает размер и иногда слегка меняет секции, тогда как цель морфера — разрушение устойчивых статических признаков и усложнение автоматического анализа. Часто морфер — это не один бинарный модуль, а целая сборочная цепочка с параметрами случайности, шаблонами перемешивания, выбором заполнителей, правилами перестройки графа переходов и каталогом «синонимов» для эквивалентных последовательностей инструкций.

Отдельного внимания заслуживает серверный полиморфизм: приём, при котором единая инфраструктура хранит исходный образ полезной нагрузки, но каждую выдачу сопровождает генерацией новой оболочки, свежих метаданных, недетерминированных PE-полей и заполняющих блоков. Такое изящество обеспечивает бесконечную череду итоговых хэшей и ставит крест на простом индикаторном поиске.

Какие преобразования применяет морфер

Набор техник огромен, но в реальных цепочках встречается узнаваемое ядро. Часть приёмов добавляет шум, другая — меняет структуру, третья — усложняет реверс. Все вместе они формируют ансамбль, нацеленный на срыв статического анализа и затягивание динамического профилирования.

-

Шифрование и упаковка. Полезная логика хранится в зашифрованном виде, ключ подбирается случайно для каждой сборки, дешифратор генерируется из шаблонов. Часто используется каскад: сжатие, затем шифрование, затем «соление» заголовков.

-

Подмена инструкций (instruction substitution). Блоки переписываются через эквивалентные последовательности, варьируются регистры, переставляются безвредные операции, меняется расположение вычислений. На выходе граф выполнения сохраняется, а машинное представление перестраивается.

-

Ротация регистров и переменных. Генератор применяет рандомизацию назначений, внедряет переименования на уровне SSA-представления и меняет порядок загрузки операндов.

-

Уплощение управления потоком (control-flow flattening). Вместо естественных веток вводится единый диспетчер с «кейсовыми» переходами, а истинные условия прячутся за непрозрачными предикатами (opaque predicates).

-

Вкрапления мусорных инструкций и блоков. Добавляются бессмысленные вычисления, ложные вызовы, искусственные циклы, «пустые» тела обработчиков исключений.

-

Мутация строк и импортов. Текстовые константы шифруются, API вызываются через хеши, таблицы импортов уплощаются, а часть функций резолвится в рантайме через обход PEB или прямую работу с таблицами экспорта.

-

Перетряхивание образа. Переименовываются секции, меняются флаги выравнивания, тасуются порядки, двигаются границы, подделываются временные метки, вставляются «паразитные» ресурсы. Типичный приём — лёгкое снижение/повышение энтропии, чтобы не привлекать простейшие эвристики.

-

Фрагментация полезной нагрузки. Код рубится на части и собирается в памяти на лету через стол таблиц адресов и непрямые переходы. Иногда добавляется «прыгающий» декодер, который восстанавливает по частям и сразу исполняет.

-

Виртуализация. Логика транслируется в байткод частной виртуальной машины, а снаружи видны только интерпретатор и поток псевдоинструкций. Такой подход резко усложняет реверс, хотя оставляет характерные следы.

В сценариях с документами и скриптами список другой, но смысл тот же. Для JavaScript/PowerShell/VBA меняются идентификаторы, перестраивается порядок блоков, код дробится на функции-обёртки, строки кодируются в Base64 или через XOR, а вызовы системных возможностей захламляются цепочками отражений, динамических выражений и незаметных преобразований.

Антианализ и средовые ухищрения

Любая маскировка усиливается блоками антианализа. Загрузчики проверяют окружение, считают ядра, ищут «подозрительные» драйверы, изучают странички CPUID, тестируют тайминги и задержки, сканируют модульные списки, смотрят порции памяти на предмет хуков. Цель проста: не стартовать в песочнице, не раскрывать полезную нагрузку под трассировкой, не отдавать поведение на наблюдение EDR-агенту.

-

Выявление виртуальных платформ. Проверяются фирменные устройства, служебные процессы, специфичные MAC-префиксы, гипервизорные биты, редкие аномалии ACPI-таблиц. Часто анализируется скорость высокоточных счётчиков, чтобы поймать однократные «провалы» времени под инструментами отладки.

-

Поиск маркеров инструментов. Ищутся известные DLL отладчиков, служебные окна, драйверы трассировщиков, именованные каналы песочниц, артефакты популярной телеметрии. Иногда добавляется проверка «холодного» профиля пользователя: пустые «Документы», отсутствие истории браузера, фиктивные SID и непривычные последние логоны.

-

Отложенный запуск и многоступенчатая выдача. Устанавливается длинный таймер, внедряется период ожидания простоя, используется «будильник» по социальным сигналам: активное движение мыши, реальный набор текста, сетевые события.

-

Ступенчатое дешифрование. Полезная логика раскрывается порциями только перед самим вызовом. Трассировщику сложнее поймать цель целиком, а статическим средствам не за что зацепиться.

Эти меры не связаны напрямую с морфингом, но в сочетании создают очень непредсказуемый профиль, вынуждая защиту смещаться к поведенческим подходам и сильнее полагаться на телеметрию реального времени.

Как выглядит производственная линия морфера у злоумышленника

Современные группы строят полноценные сборочные конвейеры. На входе — исходники загрузчика и полезной нагрузки, в середине — набор шаблонов мутации, на выходе — тысячи уникальных артефактов с независимыми хэшами. Управляющая часть выбирает семена случайности, комбинирует техники, крутит параметры энтропии, прописывает новые компоновки секций, подмешивает приманочные ресурсы и управляет зависимостями. Для веб-кампаний подключается серверный полиморфизм: веб-узел или API отдаёт свежесобранный файл при каждом обращении партнёра, сохраняя агрегированную статистику и быструю обратную связь о детектах.

Немаловажен аудит следов. После первых рассылок атакующие собирают отчёты о срабатываниях от сервисов проверки вложений и публичных сканеров, подгоняют правила генерации, перестраивают набор подстановок и перекраивают место встраивания дешифратора. Такой цикл позволяет «держать чистоту» (FUD — fully undetectable) достаточно долго, чтобы обеспечить полезную отдачу кампании.

Как защитникам отличать маску от сути

У классической сигнатуры мало шансов против точечной вариативности, зато у защитников есть инструменты для работы с инвариантами. Там, где внешний вид прыгает, остаются устойчивые зависимости: характер сетевого трафика, последовательности системных вызовов, паттерны доступа к реестру, поведение с файлами, схемы инъекций, дескрипторы синхронизации, точное время загрузки модулей.

-

Похожие хэши и «нечёткое» сравнение. ssdeep, TLSH и родственные алгоритмы улавливают сродство между близкими образами, когда точный хэш бесполезен. Для задач группировки это бесценная опора.

-

Структурные признаки. Смотрятся размеры секций, относительные смещения, плотность импортов, энтропийные профили, соотношения кода и данных. Даже при смене имён и перестановках сохраняются статистические закономерности.

-

Графовые метрики. Сравниваются формы управляющих графов, вычисляется изоморфизм на грубом уровне, анализируются характерные «горбы» диспетчеров после уплощения, оценивается распределение степеней вершин и глубины доминаторов.

-

Поведенческие модели. Строятся последовательности API-вызовов, измеряются интервалы между этапами, фиксируются редкие комбинации опций, изучается порядок сетевых рукопожатий, снимаются JA3/JA4-отпечатки для TLS.

-

Динамическая распаковка. Песочницы с «форсированным» выполнением разворачивают защищённые блоки, снимают дампы из памяти и возвращают на статический анализ уже очищенное тело.

-

Правила YARA. Выражаются признаки на уровне семейств, дополняются модулем pe, dotnet, elf, используются сдвиги, группы альтернатив и аккуратные «дырки» между токенами. Так удаётся цеплять сущность вместо сиюминутной оболочки.

Отдельное направление — телеметрия конечных точек и централизованные события. ETW-провайдеры, журналы контрольных подсистем, аналитика антивредоносных платформ, события драйверов мониторинга — всё это помогает отследить цепочки инъекций, ловушки на процессах, аномальные загрузки библиотек и нехарактерные запускаемые файлы во временных каталогах.

Признаки, по которым можно заподозрить морфер в образе

Опытный реверсер распознает множество косвенных маркеров. Приведём характерные наблюдения, полезные для экспресс-проверки вложений и подозрительных исполняемых файлов.

-

Нетипичные секции, странные имена, необычные флаги на исполняемых областях и ресурсы с нереалистичными датами. Часто встречается повторяющаяся энтропия в разных кусках образа или искусственно сглаженный профиль.

-

Переходы через таблицы с индексами, диспетчер с большими «кейсовыми» ветками и плотные участки с непрозрачными условиями. Такой рисунок наводит на мысль об уплощении управления и генераторе с шаблонами.

-

Массовые вызовы резолвинга адресов, вычисление хешей для имён API, проход по PEB/TEB, получение указателей на таблицы экспорта без обращения к стандартному загрузчику. Подобные конструкции выдают желание спрятать импорт.

-

Странные задержки, бессмысленные циклы ожидания, проверки флагов гипервизора, чтение реестровых веток с настройками отладчиков, попытки обнаружить служебные драйверы. Это уже не морфинг как таковой, но часто идёт в комплекте.

Практика анализа: с чего начинать и куда смотреть

Хорошая тактика — разделить задачу на базовые этапы и двигаться от общего к частному. Сначала собирается внешняя картина, затем — снимается оболочка, после — строится поведение. Важно не растрачивать время на эстетические перестановки там, где поможет автоматическая распаковка.

-

Быстрый первичный осмотр. Проверяются хэши, запускаются «нечёткие» функции сравнения, оцениваются секции, энтропия, импорты. В этом помогают инструменты класса «определитель упаковщиков» и анализаторы заголовков. Для справки подойдут Detect It Easy, RetDec, Ghidra, radare2.

-

Контролируемое выполнение. Песочница с возможностью «форсить» переходы, фиксировать распаковку и сохранять память после дешифрования. Для исследований подойдёт изолированная VM с Sysmon, трассировкой ETW и сбором сетевых отпечатков.

-

Выделение инвариантов. Записываются устойчивые последовательности действий, паттерны доступа к реестру, схемы работы с службами, типовые инъекции. На этой основе затем формируются поведенческие детекторы.

-

Осторожное формирование правил. Правила YARA пишутся на уровне семейств, с прицелом на стабильные фрагменты: подписи дешифраторов, шаблонные диспетчеры, характерные таблицы для виртуализирующих движков. Любой узкий токен снабжается «дырками», чтобы прожить дольше одного релиза морфера.

Где проходит граница между допустимой защитой и избыточной обфускацией

Морфинг — не только оружие злоумышленников. В коммерческих продуктах встречаются добросовестные упаковщики кода, лицензционные обёртки, виртуализация критичных алгоритмов, защита от пиратства. Разница в этике и балансе: прозрачные компании всё равно публикуют модели угроз, уделяют внимание совместимости с защитным ПО и предупреждают о сложностях сопровождения. При этом любой радикальный «грим» усложняет тестирование, вызывает проблемы в эксплуатации и с лёгкостью ломает ожидаемые сценарии обновления. Поэтому в инженерной практике разумно минимизировать «магическое» сокрытие и опираться на рачительную архитектуру, проверенные библиотечные решения и строгий контроль поставок.

Ошибки защитников, которые радуют авторов морферов

Слабые места защиты редко связаны с недостатком инструментов — чаще с невнимательностью к фундаментальным процессам. Когда реагирование построено вокруг почтовых шлюзов и отдельных сигнатур, а телеметрия конечных точек игнорируется, морферу достаточно слегка повернуть ручку энтропии. Когда правила YARA пишутся «по верхам» и цепляются за красивые строки, генератор меняет словарь, и детект пропадает. Когда нет CI-процесса для правил и тестовых корпусов, любая доработка превращается в лотерею с ложными срабатываниями.

С другой стороны, устойчивое покрытие невозможно без совместной дисциплины. Нужны версии правил, воспроизводимые наборы образцов, ротация контрольных корпусов, автономные проверки отпечатков TLS, регулярные «прогоны» в песочнице и наследование знаний по семействам. Морфер вынуждает играть вдолгую — это вопрос культуры, а не одной волшебной утилиты.

К чему всё идёт: тенденции и будущее противостояния

Авторы морферов активно экспериментируют с генеративными методами. Вариативность инструкций строится через стохастические переписыватели, наборы подстановок выбираются интеллектуальными политиками, а конфигурации выдают облачные оркестраторы под конкретные кампании. В ответ защитники применяют графовые эмбеддинги, последовательностные модели для API-трасс, ассоциативные индексы для «нечётких» структурных отпечатков, коррелируют временные ряды телеметрии и строят эффекторные детекторы поверх событий ETW. Статическое сопоставление больше не единственный герой — победа достигается на уровне богатой контекстной картины.

Ещё одна линия — прозрачность цепочек поставок. Там, где предприятие умеет воспроизводить сборки, подписывает артефакты, проверяет доверенные источники и ограничивает привилегии исполнения, морферу сложнее пролезть. Даже если маска идеальна, безукоризненно сымитировать здоровый жизненный цикл внутри защищённой инфраструктуры почти невозможно.

Выводы и практические ориентиры

Морфер — это не мифический «невидимка», а вполне земной инженерный механизм, который меняет облик вредоносной программы, оставляя стабильной её суть. Он играет против шаблонов, избытка доверия к статике и нехватки телеметрии. Хорошая оборона снимает «грим» динамической распаковкой, ищет инварианты в поведении, группирует варианты через похожие хэши и структурные признаки, укладывает знания в аккуратные правила и регулярно проверяет живучесть детектов на свежих корпусах.

Практический минимум для зрелой команды таков: уметь автоматически разворачивать оболочки, хранить набор устойчивых индикаторов по семействам, контролировать повторное обнаружение на изменённых вариантах, фиксировать поведенческие профили и поддерживать процедуру быстрой коррекции правил. На горизонте — рост роли графовых методов и телеметрического анализа, а в ближней перспективе — банальная дисциплина в сборе артефактов, меток и контекстов.

Тем, кто исследует вложения и исполняемые файлы, пригодится арсенал из нескольких направлений. Для первичной оценки подойдут DIE/Detect It Easy или аналоги для чтения заголовков и секций. Для углублённой распаковки — изолированная лаборатория с журналированием событий и дампами памяти. Для формализации признаков — аккуратные правила YARA, ориентированные на устойчивые куски логики. Для группировок — «нечёткие» хэши наподобие ssdeep и TLSH. В сочетании эти части образуют защитный контур, способный пережить десятки итераций маскировки.

Самое важное — не спорить с реальностью. Морферы были, есть и будут, потому что вариативность — дешёвый способ испортить жизнь статическим правилам. Побеждает тот, кто быстрее снимает маску и умеет распознавать сущность по поступкам, а не по костюму.