Если нужна красивая серия «по мотивам», хватит Midjourney или ChatGPT Images. Если нужно стабильное сходство, повторяемая поза, один и тот же человек в разных сценах и контроль над кадром почти на уровне ручной съёмки, главная связка сегодня другая: Stable Diffusion плюс LoRA для лица и ControlNet для позы, композиции или глубины. Midjourney в такой задаче удобен как быстрый генератор идей, но не как самый точный инструмент для портретной серии.

Проблема большинства ИИ-фотосессий не в том, что нейросеть «плохо рисует». Проблема в том, что задачу ставят неверно. Пользователь пишет общий запрос, берёт одно неудачное селфи и ждёт точного сходства. В ответ получает красивого, но чужого человека. Правдоподобный результат начинается с того, что выбирают правильный инструмент, работают с хорошими исходниками и пишут короткий технический промт, а не литературные описания вроде «роскошный свет» или «идеальная кожа».

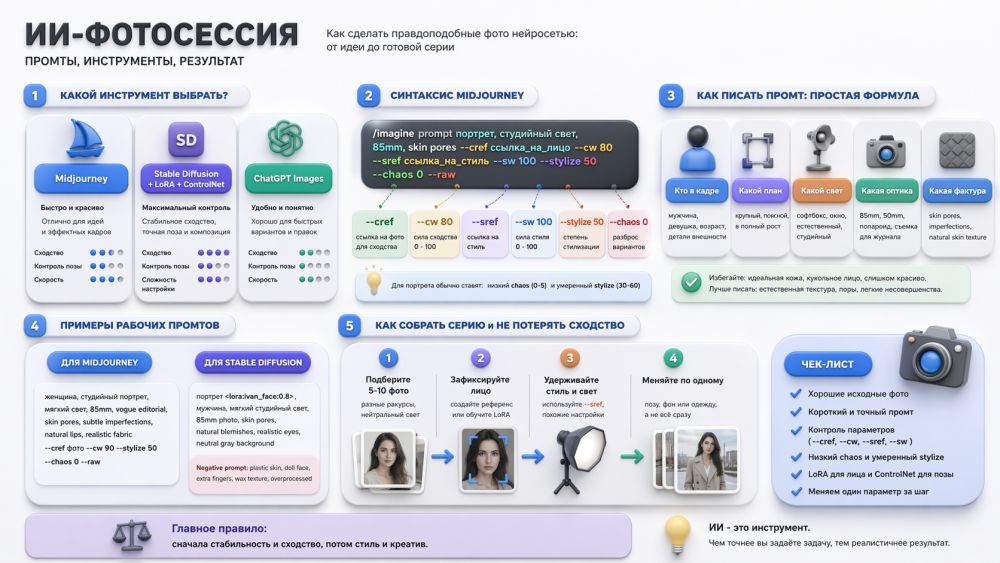

Какой инструмент выбрать для ИИ-фотосессии

Midjourney подходит, когда нужен быстрый, эффектный и стилистически сильный результат.

Чтобы удержать персонажа, Midjourney использует Character Reference. В запросе после основного текста добавляют параметр --cref и ссылку на картинку с лицом.

Чтобы регулировать, насколько жёстко модель будет держаться за референс, используют --cw со значениями от 0 до 100.

Для переноса визуальной манеры работает --sref, а силу влияния стиля меняют через --sw.

За «художественность» отвечает --stylize или короткая запись --s, а за разброс вариантов отвечает --chaos.

Stylize управляет балансом между буквальным следованием запросу и более свободной художественной интерпретацией, а Chaos увеличивает различие между вариантами.

Рабочий синтаксис у Midjourney выглядит так: /imagine prompt woman in black blazer, studio portrait, octabox lighting, 85mm lens, skin pores, subtle under-eye texture --cref URL_ВАШЕГО_ФОТО --cw 80 --sref URL_СТИЛЯ --sw 100 --stylize 50 --chaos 0 --raw. Параметр --raw снижает фирменную «приукрашенность» Midjourney и часто помогает убрать лишний глянец с кожи. Для портретов с упором на сходство обычно ставят невысокий Stylize и почти нулевой Chaos. Если поднять Stylize слишком высоко, лицо чаще уходит в красивую, но менее точную интерпретацию.

Stable Diffusion нужен в другом сценарии. LoRA помогает дообучить модель на конкретном лице или образе, чтобы нейросеть узнавала одного и того же человека. ControlNet добавляет пространственный контроль: можно задать позу через skeleton, контур, глубину, сегментацию или исходный кадр и заставить генерацию держаться за структуру. В экосистеме AUTOMATIC1111 поддержка LoRA встроена, а для ControlNet есть отдельное расширение с набором моделей под разные типы управления. Для профессиональной ИИ-фотосессии такой стек обычно надёжнее Midjourney, потому что разделяет две задачи: LoRA держит личность, ControlNet держит позу и композицию.

| Задача | Инструмент | Почему подходит |

|---|---|---|

| Быстро сделать красивую серию | Midjourney | Сильный стиль, удобные референсы, хороший результат без долгой настройки |

| Повторить одного человека в разных сценах | Midjourney + --cref | Помогает удержать лицо, но не даёт полного контроля над позой |

| Сделать максимально похожий портрет по фото | Stable Diffusion + LoRA | Когда модель дообучают под конкретное лицо, сходство становится более стабильным |

| Жёстко зафиксировать позу и композицию | Stable Diffusion + ControlNet | Можно управлять позой, глубиной, контуром и раскладкой кадра |

Как писать промты, чтобы лицо не стало «пластиковым»

Современные модели хуже реагируют на расплывчатые эпитеты, чем на короткие технические подсказки. Вместо «фотореалистичный портрет красивой девушки» лучше писать языком съёмки: тип света, фокусное расстояние, фактура кожи, носитель, стиль журнала или характер камеры. Для правдоподобия полезны слова skin pores, imperfections, natural skin texture, editorial lighting, 85mm lens, softbox, window light, polaroid shot, vogue editorial. Если сервис понимает отрицательные подсказки, туда стоит убирать wax skin, extra fingers, overprocessed face, doll-like skin, glossy plastic texture.

Для Midjourney запрос лучше держать коротким. Сначала объект и сцена, потом свет и оптика, потом 2–4 точные детали фактуры, потом параметры. Для Stable Diffusion логика похожая, но там обычно добавляют отдельный negative prompt и подключают LoRA или ControlNet уже на уровне интерфейса. Универсальная формула выглядит так: кто в кадре, какой план, какой свет, какая оптика, какая фактура кожи и ткани, какой стиль съёмки, какие технические ограничения.

Пример для Midjourney.

woman, close-up studio portrait, octabox lighting, 85mm lens, vogue editorial, skin pores, subtle imperfections, natural lips, realistic fabric texture, clean gray backdrop --cref URL_ФОТО --cw 90 --stylize 50 --chaos 0 --raw

Пример для Midjourney в более «живом» стиле.

man, candid street portrait, polaroid shot, overcast daylight, 50mm lens, slight motion blur, natural skin texture, under-eye detail, wet asphalt reflections --cref URL_ФОТО --cw 70 --stylize 40 --chaos 5 --raw

Пример для Stable Diffusion.

portrait photo of <lora:ivan_face:0.8> man, studio editorial, 85mm photo, soft key light, skin pores, natural blemishes, realistic eyes, neutral gray background

Negative prompt для Stable Diffusion.

plastic skin, doll face, extra fingers, asymmetrical eyes, deformed teeth, overretouched, oversharpen, wax texture, bad anatomy

Если нужен один и тот же человек в серии, сначала делают базовый удачный кадр. Потом меняют только один параметр за шаг: позу, фон или одежду. Когда пользователь сразу прыгает между «студия», «улица ночью», «пляж», «офис», «чёрно-белое фото» и «кинопостер», нейросеть начинает пересобирать лицо заново. Для сходства важнее стабильность пайплайна, чем красота первого результата.

Как собрать серию кадров и не потерять сходство

Лучший вход для любой ИИ-фотосессии – 5–10 чистых фото одного человека без фильтров, с нейтральным светом и разными ракурсами. Для Midjourney один сильный референс иногда работает, но несколько исходников всё равно полезнее на этапе отбора. Для Stable Diffusion набор снимков нужен уже для того, чтобы обучить LoRA. После этого ControlNet можно использовать, чтобы копировать позу с образца, переносить композицию или удерживать форму тела. Такой подход снимает главную проблему портретных генераторов, когда лицо похоже, а осанка, руки и посадка головы живут отдельно.

Раздел про ошибки здесь лучше не разносить по статье, потому что почти все ошибки уже видны в технике работы. Не берите одно плохое селфи. Не пишите длинный литературный текст вместо промта. Не завышайте Stylize, если нужен человек, а не красивая версия человека. Не поднимайте Chaos, если нужна серия кадров в одной манере. Не пытайтесь одной командой получить и сходство, и драматичную стилизацию, и сложную позу, и безупречные руки. Сначала фиксируйте личность, потом свет и одежду, затем позу и фон.

FAQ

Midjourney или Stable Diffusion?

Для быстрых красивых кадров удобнее Midjourney. Для точного сходства, контроля позы и повторяемости серии сильнее Stable Diffusion с LoRA и ControlNet.

Какие параметры Midjourney важнее всего для портрета?

Для сходства чаще всего важны --cref, --cw, --stylize, --chaos и --raw. Стиль между кадрами помогает держать --sref и --sw.

Почему лицо всё равно меняется?

Обычно причина в слабом референсе, слишком высоком Stylize, большом разбросе сцен или попытке менять слишком много параметров за один шаг.

Какие слова лучше убирают «пластик»?

Чаще помогают skin pores, natural skin texture, imperfections, subtle under-eye detail, realistic fabric texture и raw style. Но решает не одно слово, а весь набор настроек и исходников.

Если нужна эффектная ИИ-фотосессия без долгой возни, начинайте с Midjourney и используйте --cref, --cw, --sref, --sw, низкий --stylize, низкий --chaos и --raw. Если нужна серия с почти одинаковым лицом, заданной позой и предсказуемым результатом, берите Stable Diffusion, обучайте LoRA на лице и подключайте ControlNet для позы и композиции. В такой схеме нейросеть перестаёт гадать и начинает работать как управляемый инструмент.