Все откладывал как-то эту тему, но тут что-то критическая масса накопилась - за вчерашний день попало на глаза несколько новостей/статей про обход биометрических систем. Об этом и будет заметка. Начну, пожалуй, с шуточного видео, за которым при этом скрыта очень большая проблема, название которой deepfake. Если первая версия одноименного приложения накладывала лица на видео очень некачественно, то китайское приложение ZAO делает это на порядок лучше. Посмотрите, как с помощью всего одной фотографии (аватарки с соцсети) смогли поменять лицо Леонардо ДиКаприо в фильмах с его участием.

Меня эта тема интересует последние пару лет, когда только появилось первое приложение DeepFake и когда Банк России стал семимильными шагами внедрять Единую Биометрическую Систему (ЕБС). Когда ЦБ выпустил свое Указание 4859-У, то я надеялся, что там такого рода угрозы найдут отражение, но все, что хоть как-то можно отнести к ним, это расплывчатая формулировка про актуальность угроз нарушения целостности (подмены) биометрических персональных данных. Настолько абстрактное понятие, что даже непонятно, о чем идет речь - о deepfake или о подмене свертки биометрического фактора?

Была надежда, что в 321-м приказе МинЦифры или в МР-4 Банка России включат раздел про нейтрализацию таких угроз, но увы. И эти документы оказались далеки от прикладных атак, концентрируясь либо на применении криптографии, либо на применении сертифицированной ОС, МСЭ и антивируса, напрочь забыв даже про защитные меры из 21-го приказа ФСТЭК по защите ИСПДн. Последний, перекрывая по своему содержанию и МР-4 и приказ №321, тоже ни слова не говорит о том, как. бороться с deepfake.

Самое неприятное, что на различных мероприятиях или в соцсетях, где присутствуют участники процесса, связанного с ЕБС, упорно обходят молчанием эту тему, даже если им задаешь напрямую вопрос о том, как бороться с этой проблемой. Хоть какой-то ответ я нашел в одной презентации "Центра речевых технологий", чьи технологии используются в ЕБС, например, у того же Банка "Открытие" и ряда других (решение VoiceKey.INSPECTOR). Правда, используются они при сборе биометрии, а проблема с deepfake возникает на этапе ее проверки в режиме повседневной эксплуатации.

Если посмотреть на классический жизненный цикл биометрической, то он в обязательном порядке должен содержать этап проверки "живости", без которого биометрия не имеет никакой ценности, несмотря на использование СКЗИ класса КВ или даже КА.

В своих материалах ЦРТ приводит методы проверки живости для изображения лица, как биометрического признака:

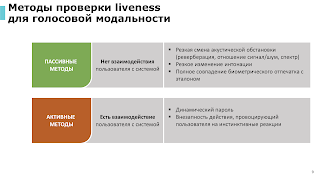

и для голоса, как второго биометрического признака:

Но какие из этих методов реализованы в ЕБС не совсем понятно. В описании того же "Ключа" от Ростелоекома говорится о liveness detection, но без каких-либо деталей и уточнений. А судя по презентациям отдельных банков, которые бодро отрапортовали о том, что они не только интегрировались с ЕБС, но и внедряют уже биометрию в свои банковские процессы, далеко не все понимают угрозу deepfake и борются с ней. Например, один из банков предлагает возможность перевода денег без указания номера карты или телефона, "просто сфотографировав получателя". В данной схеме даже liveness detection никакого нет - работа со статическим биометрическим признаком, который подделать ничего не стоит.

При этом злоумышленники достаточно активно осваивают тему подмены или обхода биометрии, начиная ее использовать в своих целях. Например, недавний случай, когда злоумышленники выманили 220 тысяч евро с помощью подмененного голоса генерального директора ( на русском). Интересно, что об этом предупреждали пару месяцев назад. Схожий метод, но в массовом масштабе (без привязки к ЕБС) применяется для создания поддельных видео со звездами, которые "рекламируют" что-то. Самое интересное, что исследований, которые показывают, как обойти биометрию, публикуется в разы больше, чем тех, которые показывают, как с этим бороться. Например, свежий, августовский доклад на BlackHat о том, как взламывать liveness detection. В прошлом году на BlackHat прозвучал доклад о том, как обходить голосовую аутентификацию. Вообще на BlackHat очень много выступлений было посвящено тому, как обходить эту технологию.

Если посмотреть на обратную сторону, на то, что можно противопоставить deepfake, то тут исследований не так уж и много. На последних крупных конференциях по ИБ я вспомнил только одно. А вот с готовыми решениями по этой теме, что-то не густо. Что-то встроено в сами биометрические решения, но не во все. В отличие от идентификации фальшивых изображений ( OZ Forensics) или собственно самой биометрической идентификации. И тут остается полагаться на здравый смысл безопасников, которые будут следовать не только нормативных актам регуляторов, но и самостоятельно задавать вопросы производителям внедряемых решений о том, как те борятся с deepfake. Ибо цена ошибки достаточно высока, а ответственности за взлом биометрической системы регуляторы не несут; как и сами вендоры, которые продают свою решения по принципу "AS IS". Как минимум, стоит посмотреть в сторону решений по многофакторной аутентификации, которые могут частично. нивелировать проблемы, связанные с низкой защищенностью биометрии.

Отдельная тема, которая пока не имеет какого-то решения, это проведение экспертизы в случае конфликтных ситуаций, которые однозначно появляются в случае обхода биометрии злоумышленниками. Это что-то сродни фототехнической криминалистической экспертизе, но для биометрических признаков (голоса и видео). Не знаю, насколько в России есть у кого-то опыт именно в этой части (хотя вот вчерашний пример). Но при внедрении биометрии, стоит держать в голове этот вопрос и иметь какой-то ответ на него.

Меня эта тема интересует последние пару лет, когда только появилось первое приложение DeepFake и когда Банк России стал семимильными шагами внедрять Единую Биометрическую Систему (ЕБС). Когда ЦБ выпустил свое Указание 4859-У, то я надеялся, что там такого рода угрозы найдут отражение, но все, что хоть как-то можно отнести к ним, это расплывчатая формулировка про актуальность угроз нарушения целостности (подмены) биометрических персональных данных. Настолько абстрактное понятие, что даже непонятно, о чем идет речь - о deepfake или о подмене свертки биометрического фактора?

Была надежда, что в 321-м приказе МинЦифры или в МР-4 Банка России включат раздел про нейтрализацию таких угроз, но увы. И эти документы оказались далеки от прикладных атак, концентрируясь либо на применении криптографии, либо на применении сертифицированной ОС, МСЭ и антивируса, напрочь забыв даже про защитные меры из 21-го приказа ФСТЭК по защите ИСПДн. Последний, перекрывая по своему содержанию и МР-4 и приказ №321, тоже ни слова не говорит о том, как. бороться с deepfake.

Самое неприятное, что на различных мероприятиях или в соцсетях, где присутствуют участники процесса, связанного с ЕБС, упорно обходят молчанием эту тему, даже если им задаешь напрямую вопрос о том, как бороться с этой проблемой. Хоть какой-то ответ я нашел в одной презентации "Центра речевых технологий", чьи технологии используются в ЕБС, например, у того же Банка "Открытие" и ряда других (решение VoiceKey.INSPECTOR). Правда, используются они при сборе биометрии, а проблема с deepfake возникает на этапе ее проверки в режиме повседневной эксплуатации.

Если посмотреть на классический жизненный цикл биометрической, то он в обязательном порядке должен содержать этап проверки "живости", без которого биометрия не имеет никакой ценности, несмотря на использование СКЗИ класса КВ или даже КА.

В своих материалах ЦРТ приводит методы проверки живости для изображения лица, как биометрического признака:

и для голоса, как второго биометрического признака:

Но какие из этих методов реализованы в ЕБС не совсем понятно. В описании того же "Ключа" от Ростелоекома говорится о liveness detection, но без каких-либо деталей и уточнений. А судя по презентациям отдельных банков, которые бодро отрапортовали о том, что они не только интегрировались с ЕБС, но и внедряют уже биометрию в свои банковские процессы, далеко не все понимают угрозу deepfake и борются с ней. Например, один из банков предлагает возможность перевода денег без указания номера карты или телефона, "просто сфотографировав получателя". В данной схеме даже liveness detection никакого нет - работа со статическим биометрическим признаком, который подделать ничего не стоит.

При этом злоумышленники достаточно активно осваивают тему подмены или обхода биометрии, начиная ее использовать в своих целях. Например, недавний случай, когда злоумышленники выманили 220 тысяч евро с помощью подмененного голоса генерального директора ( на русском). Интересно, что об этом предупреждали пару месяцев назад. Схожий метод, но в массовом масштабе (без привязки к ЕБС) применяется для создания поддельных видео со звездами, которые "рекламируют" что-то. Самое интересное, что исследований, которые показывают, как обойти биометрию, публикуется в разы больше, чем тех, которые показывают, как с этим бороться. Например, свежий, августовский доклад на BlackHat о том, как взламывать liveness detection. В прошлом году на BlackHat прозвучал доклад о том, как обходить голосовую аутентификацию. Вообще на BlackHat очень много выступлений было посвящено тому, как обходить эту технологию.

Если посмотреть на обратную сторону, на то, что можно противопоставить deepfake, то тут исследований не так уж и много. На последних крупных конференциях по ИБ я вспомнил только одно. А вот с готовыми решениями по этой теме, что-то не густо. Что-то встроено в сами биометрические решения, но не во все. В отличие от идентификации фальшивых изображений ( OZ Forensics) или собственно самой биометрической идентификации. И тут остается полагаться на здравый смысл безопасников, которые будут следовать не только нормативных актам регуляторов, но и самостоятельно задавать вопросы производителям внедряемых решений о том, как те борятся с deepfake. Ибо цена ошибки достаточно высока, а ответственности за взлом биометрической системы регуляторы не несут; как и сами вендоры, которые продают свою решения по принципу "AS IS". Как минимум, стоит посмотреть в сторону решений по многофакторной аутентификации, которые могут частично. нивелировать проблемы, связанные с низкой защищенностью биометрии.

Отдельная тема, которая пока не имеет какого-то решения, это проведение экспертизы в случае конфликтных ситуаций, которые однозначно появляются в случае обхода биометрии злоумышленниками. Это что-то сродни фототехнической криминалистической экспертизе, но для биометрических признаков (голоса и видео). Не знаю, насколько в России есть у кого-то опыт именно в этой части (хотя вот вчерашний пример). Но при внедрении биометрии, стоит держать в голове этот вопрос и иметь какой-то ответ на него.