Google DeepMind: DiPaCo открывает доступ к сверхмощным ИИ-моделям для всех

Компания бросает вызов Microsoft и OpenAI с помощью революционной системы обучения ИИ.

Google DeepMind представила открытую и глобально распределённую систему обучения ИИ DiPaCo, которая напоминает работу торрентов для нейронных сетей.

Разработка DeepMind является ответом на недавнее заявление Microsoft и OpenAI о запуске проекта стоимостью $100 млрд. для создания суперкомпьютера следующего поколения и центра обработки данных. Цель заключается в разработке инновационных суперумных ИИ моделей. Инициатива обещает стать значимым событием в сфере ИИ, укрепляя позиции Microsoft и OpenAI в качестве ведущих игроков на рынке.

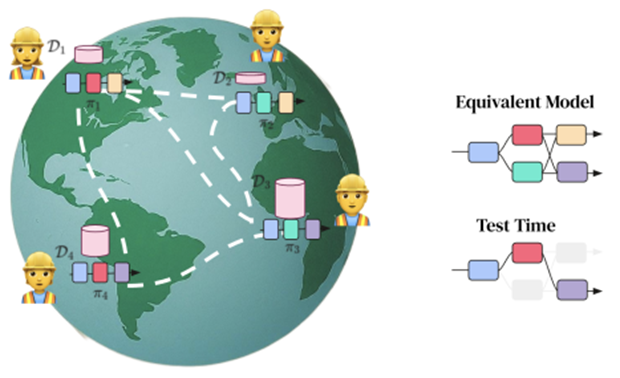

DiPaCo (Distributed Path Composition) предлагает новаторский подход к обучению нейронных сетей, задействуя вычислительные мощности по всему миру, что позволит масштабировать ИИ модели до размеров, недоступных для традиционных централизованных систем.

Распределенная система DiPaCo

В основе DiPaCo лежат два ключевых алгоритма, которые вместе создают мощный инструмент для разработки сверхумных ИИ моделей:

- DiLoCo, обеспечивающий распараллеливание процессов обработки данных;

- DiPaCo, отвечающий за распараллеливание процессов обучения моделей.

Успех DiPaCo может поставить под вопрос не только ценность многомиллиардных инвестиций Microsoft и OpenAI, но и кардинально изменить направление развития ИИ. Проект имеет потенциал демократизировать доступ к обучению сверхумных ИИ моделей, тем самым разрушая монополию текущих лидеров на рынке и способствуя быстрому прогрессу в области ИИ.

Кроме того, DiPaCo может существенно усложнить задачу для правительств, особенно для США и Китая, которые стремятся регулировать развитие ИИ через контроль над крупными дата-центрами. Распределённая структура DiPaCo делает такой контроль гораздо более сложным и менее эффективным.